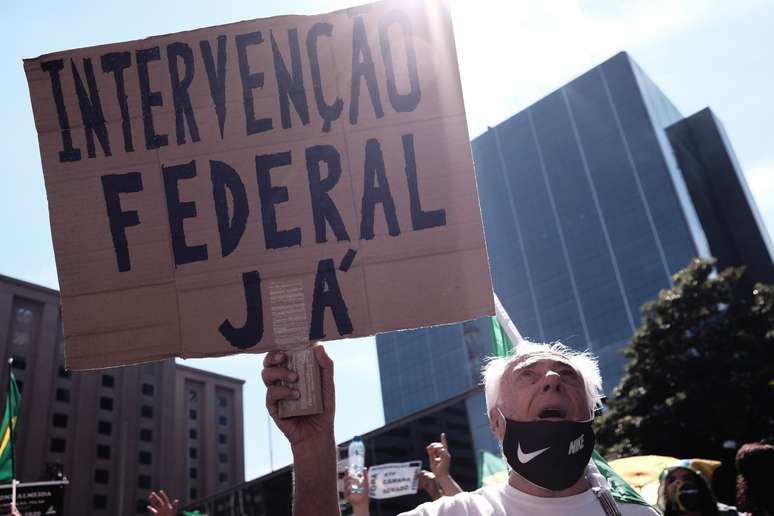

"Lucro com conteúdo extremista ameaça a democracia"

Diretora do Laboratório de Estudos de Internet e Redes Sociais (NetLab) da UFRJ critica 'modelo de negócio em torno da incivilidade' e defende regulamentação urgente de plataformas

Diretora do Laboratório de Estudos de Internet e Redes Sociais (NetLab), da Universidade Federal do Rio de Janeiro (UFRJ), a professora Rose Marie Santini defende uma regulação urgente de grandes empresas de tecnologia para combater "o financiamento de conteúdos nocivos nas redes."

Na semana passada, o corregedor-geral da Justiça Eleitoral, ministro Luis Felipe Salomão, determinou a suspensão de monetização de canais bolsonaristas envolvidos na divulgação de notícias falsas em diferentes plataformas na internet. Como mostrou o Estadão, somente no YouTube, os 14 canais atingidos pela decisão do corregedor podem gerar até US$ 2,9 milhões (cerca de R$ 15 milhões) por ano em receita.

"Ideologias e extremismo viraram mercadorias muito lucrativas. Diante desse cenário, esse mercado tem que ser seriamente regulado e isso é urgente. Caso contrário, arriscamos nossa democracia e isso nos custará muito caro", afirmou a pesquisadora.

Rose Marie vê falta de transparência das redes sociais sobre a circulação de conteúdo e avalia que a política de controle de informação "abre espaço para desconfiança" no País. "Sem uma regulamentação madura, com base em um amplo debate da sociedade e em mecanismos efetivos de auditoria e de transparência, não se vai conseguir evitar o financiamento de conteúdos nocivos nas redes."

Como está o debate sobre regulação de conteúdo nas redes sociais no Brasil?

Estamos discutindo muito pouco sobre isso. Qual o grande problema? Não temos transparência sobre o que acontece dentro das plataformas, não sabemos os filtros que as plataformas usam. Não sabemos como essas empresas classificam o conteúdo, o que elas retiram, o que não retiram, o que impulsionam, o que escondem, e por que o fazem. Por ser uma caixa-preta e não ter transparência, estamos no escuro. Precisamos de regulamentação, mas, antes de tudo, precisamos de um debate qualificado, baseado em dados e informações sobre o que acontece dentro dessas plataformas. Com mais transparência poderíamos entender a dinâmica, as estratégias e as consequências da desinformação. Como funciona, a quem beneficia. Mas a opacidade das plataformas tem impedido que pesquisadores possam ajudar a entender o que acontece. Na medida em que fossem mais transparentes, poderíamos ter mais olhos e ouvidos da sociedade civil que pudessem criar soluções e abraçar o problema. Ao resistir à maior transparência, especialmente para a pesquisa, se abre espaço para desconfiança.

É possível observar algum "enviesamento" por parte das redes no controle de conteúdo de direita, como diz o presidente Jair Bolsonaro?

O que sabemos é que conteúdos de diferentes tipos e ideologias estão sendo limitados e bloqueados. É a plataforma que decide.

Mas essa falta de transparência abre brecha para esse tipo de argumento...

O que precisamos fazer é pautar a transparência das plataformas para entendermos o que acontece ali. A partir do conhecimento do fenômeno poderemos criar regras e parâmetros que atendam aos interesses da sociedade, para então definirmos o que queremos ou não que seja considerado apropriado e inapropriado. E isso valerá para todos os lados do espectro político.

E o que motivam as plataformas a se fecharem?

O que eu acredito que motiva as plataformas é o modelo de negócio baseado na atenção. Pesquisas recentes mostram que o extremismo atiça os usuários, aumenta o contágio e a influência, amplia o compartilhamento e gera indignação, que é um dos sentimentos que mais estimulam o engajamento. O que observamos é que o extremismo e o comportamento polarizado tornaram-se muito lucrativos. As plataformas conseguiram capitalizar o fenômeno e inventaram um modelo de negócio em torno disso. Quanto mais usuários se indignam com posições contrárias às suas, mais se envolvem na participação e na produção de conteúdo para as plataformas e, assim, mais a máquina de dinheiro roda. As pessoas entram num ciclo vicioso de impor sua visão de mundo, e isso vai aumentando ainda mais o viés cognitivo e a distorção da percepção da realidade. É quase uma máquina de engajamento em torno de sentimentos negativos, uma máquina que trabalha com a emoção mais sórdida das pessoas. Esse modelo de negócio em torno da incivilidade e do extremismo é muito nocivo.

O Tribunal Superior Eleitoral (TSE) estuda obrigar as plataformas a proibir a geração de receita por páginas e canais com conteúdo político e extremista durante as eleições. Como estamos na discussão sobre a regulação de políticas de anúncio em plataformas digitais?

A questão da mídia programática e das políticas de anúncio nas plataformas é um debate urgentíssimo que precisamos enfrentar. Outros países estão bem mais avançados. Por um lado, isso mostra que estamos desarticulados, atrasados e lidando mal com o problema. Por outro, podemos aprender com a experiência de outros lugares para encontrar soluções para nós. Por exemplo: nos Estados Unidos, o Google oferece uma biblioteca de anúncios para dar mais transparência à publicidade política exibida em suas plataformas, e isso tornou a campanha eleitoral americana de 2020 mais transparente e ajudou na aplicação da própria regulamentação eleitoral sobre financiamento de campanhas. No Brasil, a Alfabet (empresa que gere o Google) não teve essa iniciativa e não temos nenhum dado sobre anúncios no Google e no YouTube, por exemplo. Digo isso sobre o que as plataformas poderiam estar fazendo para sanar o problema.

É uma forma viável para conter a recirculação de conteúdo extremista?

Uma resolução que proíba a geração de receitas em páginas e canais com conteúdo político e extremista coloca novamente o problema da arbitragem sobre os conteúdos: quem classificará os conteúdos e com que critérios? Quem definirá o que é "político e extremista" e como vamos fiscalizar a aplicação desta resolução? Ou seja, sem uma regulamentação madura, com base em um amplo debate da sociedade e em mecanismos efetivos de auditoria e de transparência, não vamos conseguir evitar o financiamento de conteúdos nocivos nas redes. Porém, sabemos que os conteúdos extremistas possuem diferentes mecanismos de financiamento como doações, assinaturas, crowdfunding, venda de produtos, eventos. Portanto, ou enfrentamos o problema da moderação de conteúdo com uma regulamentação para atuação das plataformas no Brasil, ou vamos ficar enxugando gelo com decisões paliativas que não são aplicáveis de fato, especialmente no período eleitoral onde formas inesperadas de financiamento irregular aparecem.

O presidente Jair Bolsonaro defende alterações no Marco Civil Internet para impedir o que ele chama de censura a perfis de direita nas plataformas. Como essa mudança afetaria a web brasileira?

Essa mudança impediria que qualquer tipo de filtro fosse colocado e que qualquer conteúdo pudesse ser retirado, o que modificaria toda a estrutura da internet e das redes sociais. Atualmente, as big techs usam filtros que retiram de suas plataformas uma série de conteúdos considerados inapropriados, como pedofilia, pornografia, violência extrema, automutilação, nudez, terrorismo e material protegido por direitos autorais. Para retirar esses conteúdos, as plataformas usam estratégias de bloqueio automáticas, com ajuda de inteligência artificial, combinadas com o trabalho de um exército de moderadores que interpretam e analisam o que deve ser retirado. Se a regra é alterada e nenhum conteúdo passa a poder ser retirado sem ação judicial prévia, todo tipo de conteúdo, incluindo os citados, necessariamente deverão permanecer nas plataformas.

E qual a dimensão desse impacto?

Isso poderá modificar a dinâmica da rede, desde como se faz campanha na internet até como as pessoas vão se mobilizar daqui para frente, transformando toda a arquitetura que existe hoje. Todos os atores teriam de adaptar seus comportamentos, desde usuários comuns até instituições e empresas, porque iria mudar a regra do jogo. Afetaria diferentes atores do mercado até as campanhas eleitorais. Por exemplo, se uma empresa disseminar desinformação sobre um concorrente, a plataforma não poderia retirar esse conteúdo, o que tornaria esse comportamento válido de alguma maneira. Isso seria desastroso. Impedir qualquer tipo de moderação é como viver numa sociedade sem lei. Não há regra de conduta, nem moral, nem ética. Seria um caos digital. Podemos entrar numa situação também onde alguns crimes na rede não poderão ser impedidos. A ausência de regras estimula crimes, nos faz perder os parâmetros do que é aceitável, ameaça a saúde da democracia e favorece o extremismo. Com essa proposta, o presidente não vai impedir somente os filtros contra si, mas qualquer tipo de filtro. As plataformas vão ficar "sujas" de conteúdo. Haverá um aumento exponencial de coisas absurdas na rede.

Os critérios das plataformas são justos?

É importante que as plataformas retirem alguns dos conteúdos que já retiram, mas que o parâmetro de bloqueio não seja definido única e exclusivamente pela plataforma, como é hoje. É importante que os parâmetros sejam definidos por uma lei que seja construída a partir de um escrutínio social, que atenda aos interesses da sociedade. Atualmente, as plataformas estão muito à vontade para filtrar e bloquear o que quiserem. Isso é complicado. O debate público está na mão dessas empresas e não pensamos nas consequências sociais do que está ou não está sendo filtrado. Precisamos debater com diferentes atores da sociedade civil, pesquisadores, especialistas, para definir esses parâmetros. Os critérios não podem ser nem de um candidato nem de uma empresa, têm de ser definidos por todos nós.

-toigiqhzoeau.png)